Apache Spark — это мощный инструмент для обработки и анализа больших объемов данных. Он является одной из самых популярных технологий в области Big Data и используется во многих сферах, включая финансы, медицину, телекоммуникации и многое другое.

На курсах программирования вы изучите основы Apache Spark и узнаете, как использовать его для решения различных задач. Начиная с введения в Apache Spark, вы узнаете о его возможностях и применении, а также о его преимуществах перед другими инструментами для работы с данными.

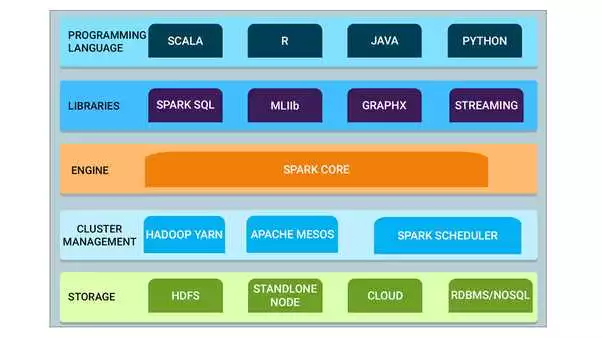

В ходе обзора Apache Spark вы познакомитесь с его основными компонентами, такими как Spark Core, Spark SQL, Spark Streaming и MLlib. Вы разберетесь в работе с RDD (Resilient Distributed Datasets), основной абстракцией данных в Spark, а также изучите возможности анализа данных с использованием SQL-запросов и машинного обучения.

Основы Apache Spark для начинающих на курсах программирования: узнай все возможности

Apache Spark — это мощный инструмент, используемый для обработки и анализа больших объемов данных. Он предоставляет программистам возможность реализовывать сложные задачи обработки данных и аналитики на большом масштабе. Если вы новичок в программировании и хотите освоить Apache Spark, курсы по этой теме предоставляют отличную возможность ознакомиться с базовыми принципами и применением этого инструмента.

На курсах программирования вы узнаете основы Apache Spark, которые позволят вам начать работать с ним с нуля. Курсы содержат подробные материалы, объясняющие основные понятия, концепции и функциональность Apache Spark. Вы узнаете, как установить Apache Spark, настроить его и начать пользоваться его возможностями.

Программа курсов начинается с введения в Apache Spark и его основных компонентов. Вы узнаете о главных концепциях, таких как RDD (распределенный набор данных) и DataFrame, и научитесь применять эти концепции для обработки и анализа данных. Курсы также включают в себя практические задания, где вы сможете применить полученные знания на практике.

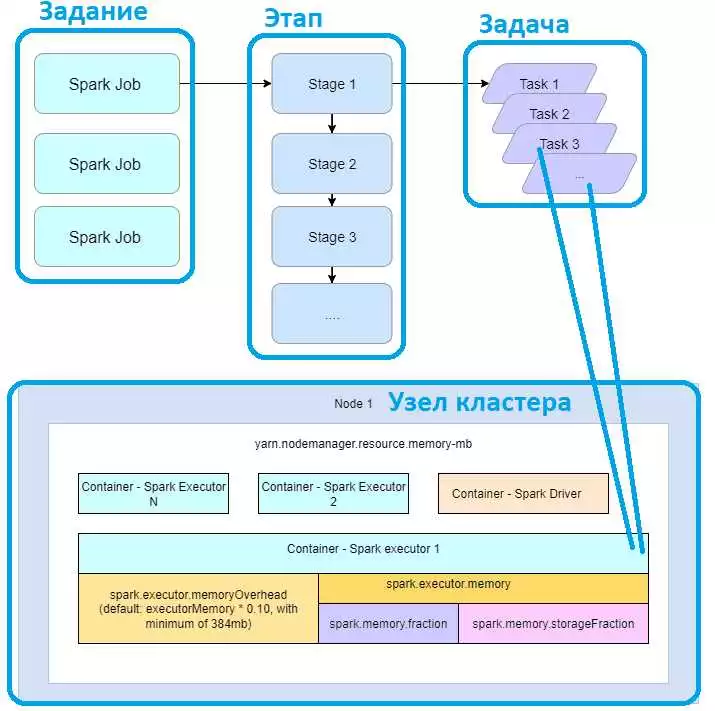

Одна из ключевых возможностей Apache Spark — его способность обрабатывать большие объемы данных параллельно. С помощью Apache Spark вы сможете выполнять распределенные вычисления на кластерах, что позволяет обрабатывать огромные объемы данных в реальном времени.

Курсы программирования по Apache Spark рассчитаны на новичков в программировании и не требуют предварительного опыта работы с этим инструментом. Они предоставляют подробные инструкции, примеры кода и практические задания, которые помогут вам освоить все основы Apache Spark и начать использовать его для обработки данных.

В заключение, если вы начинающий программист и хотите изучить Apache Spark, курсы по этой теме предоставляют отличную возможность ознакомиться со всеми основами этого мощного инструмента. Освоив Apache Spark, вы сможете выполнять сложные задачи обработки данных и аналитики на большом масштабе и значительно расширить свои возможности в сфере программирования.

Виды программирования

В данном обзоре мы рассмотрим основные виды программирования, полезные для новичков в программировании. Они помогут вам узнать о различных подходах и инструментах, которые используются в современном программировании.

1. Процедурное программирование

Процедурное программирование является одним из самых распространенных и простых подходов к программированию. Оно базируется на использовании последовательности команд (процедур), которые исполняются в определенном порядке. Применение этого подхода полезно для написания небольших программ и начального введения в программирование.

2. Объектно-ориентированное программирование

Объектно-ориентированное программирование (ООП) является более сложным и мощным подходом, который широко используется в современном программировании. Оно основано на создании классов и объектов, которые взаимодействуют друг с другом. Применение ООП позволяет создавать более гибкие и масштабируемые программы, а также позволяет повторно использовать код.

3. Функциональное программирование

Функциональное программирование основано на использовании функций первого класса и отсутствии изменяемого состояния. В этом подходе акцент делается на вычислении значений функций и использовании их в качестве аргументов и возвращаемых значений. Применение функционального программирования полезно при разработке алгоритмов, требующих высокой степени абстракции и четкой логики.

4. Декларативное программирование

Декларативное программирование описывает, что должна быть получена в результате выполнения программы, а не как это должно быть сделано. Вместо последовательности команд здесь используется набор правил и ограничений, которые описывают желаемое состояние системы. Применение декларативного программирования полезно для написания программ, в которых более важно описание задачи, а не алгоритм ее решения.

5. Многопоточное программирование

Многопоточное программирование позволяет выполнять несколько потоков исполнения параллельно. Это полезно, когда требуется выполнение нескольких задач одновременно, увеличение производительности и улучшение отзывчивости программы. Применение многопоточного программирования требует особого внимания к синхронизации данных и управлению потоками.

6. Визуальное программирование

Визуальное программирование позволяет создавать программы с помощью визуальных элементов, таких как блоки или диаграммы. Этот подход особенно полезен для начинающих программистов, которые только начинают изучать основы программирования. Применение визуального программирования позволяет более наглядно представлять структуру программы и упрощает процесс ее создания и понимания.

Узнать основы различных видов программирования можно на специализированных курсах и тренировочных платформах.

Основы работы с Apache Spark

Apache Spark — это универсальная система обработки больших данных с открытым исходным кодом. Она позволяет эффективно анализировать и обрабатывать большие объемы данных, выполнять различные аналитические задачи и работать с разнообразными типами данных.

Apache Spark предоставляет обширный набор возможностей, которые делают его популярным инструментом в области обработки данных:

- Мощная обработка данных: благодаря распределенной архитектуре и оптимизированным алгоритмам, Spark обеспечивает высокую скорость работы с данными.

- Множество API: Spark обладает более чем 80 API на разных языках, таких как Scala, Java, Python, R, SQL. Это позволяет разработчикам использовать Spark наиболее удобным для них способом.

- Поддержка различных источников данных: Spark может работать с различными типами данных и источниками, включая файлы, базы данных, Hadoop и многие другие.

- Масштабируемость: Spark позволяет масштабировать вычисления на кластерах из сотен и тысяч узлов, обеспечивая таким образом возможность обработки больших объемов данных.

- Удобство в использовании: благодаря простому и интуитивно понятному API, Spark подходит как для разработчиков с опытом, так и для новичков в области программирования.

Введение в Apache Spark для начинающих на курсах программирования позволяет ознакомиться с основами работы с этим инструментом и научиться применять его в различных сферах.

Apache Spark – мощный инструмент обработки больших данных, который обладает широкими возможностями и прост в использовании. Если вы хотите изучить и использовать Spark, то начните с основ работы с этой технологией, чтобы получить полное представление о ее возможностях и применении.

Программирование на языке Scala в Apache Spark

Apache Spark — одна из самых популярных платформ для обработки больших объемов данных. Одним из языков программирования, используемых в Apache Spark, является Scala.

Scala — мощный статически типизированный язык программирования, который сочетает в себе возможности функционального и объектно-ориентированного программирования. Из-за своей выразительности и эффективности, Scala стал языком выбора для многих разработчиков, работающих с Apache Spark.

Изучение Scala для программирования в Apache Spark может быть сложным для новичков, но с хорошими курсами и документацией, процесс становится более доступным.

Курсы программирования на Scala для начинающих предлагают введение в основы языка и его применение в контексте Apache Spark. В ходе обучения вы узнаете о ключевых концепциях Scala, таких как переменные, функции, коллекции и паттерны.

Основы программирования на Scala позволяют вам использовать мощные возможности Apache Spark для обработки данных. Вы сможете создавать и преобразовывать RDD (Resilient Distributed Datasets), работать с различными операциями, фильтровать и сортировать данные, применять агрегирующие функции и многое другое.

Кроме того, программа на Scala в Apache Spark позволяет писать более чистый и компактный код, благодаря поддержке функционального стиля программирования. Функциональные возможности Scala помогают справиться с сложными задачами обработки данных, такими как вычисление сложных алгоритмов и анализ больших объемов информации.

Для новичков в программировании на Scala и работы с Apache Spark, основы языка являются важным фундаментом. Вместе с курсами и практическим опытом, вы сможете усовершенствовать свои навыки и начать создавать мощные и эффективные приложения с использованием Apache Spark и Scala.

Применение Apache Spark

Apache Spark — это мощный инструмент для обработки и анализа больших объемов данных. Он предоставляет широкий набор функций и возможностей, которые делают его идеальным выбором для различных задач программирования.

Преимущества использования Apache Spark для начинающих:

- Высокая скорость обработки данных: Spark использует параллельную обработку и распределенные вычисления, что позволяет обрабатывать данные намного быстрее, чем традиционные инструменты.

- Масштабируемость: Spark легко масштабируется, что позволяет обрабатывать большие объемы данных без потери производительности.

- Удобный API: Spark предлагает простой и интуитивно понятный API, который упрощает написание программ и снижает сложность разработки.

- Поддержка различных источников данных: Spark может работать с различными источниками данных, такими как Hadoop Distributed File System (HDFS), Apache Cassandra, Apache Hive и многими другими.

- Обработка данных реального времени: Spark обеспечивает возможность обработки данных в реальном времени, что позволяет анализировать потоковую информацию без задержек.

- Поддержка множества языков программирования: Spark поддерживает Java, Scala, Python и R, что позволяет программистам выбирать наиболее удобный язык для решения своих задач.

Введение в Apache Spark для начинающих программистов очень полезно, поскольку он позволяет освоить основы распределенной обработки данных и аналитики. На курсах программирования вы сможете изучить все возможности Spark и научиться эффективно использовать его при разработке своих проектов.